在大模子的竞赛中,参数限制频频被视为性能的决定性成分。但近期,Liquid AI 的接洽团队提议了一个不同寻常的案例:一个仅有 3.5 亿参数的模子,进程微调后,竟能在中短凹凸文的及时日语英语翻译任务上,与 GPT-4o 竞争。

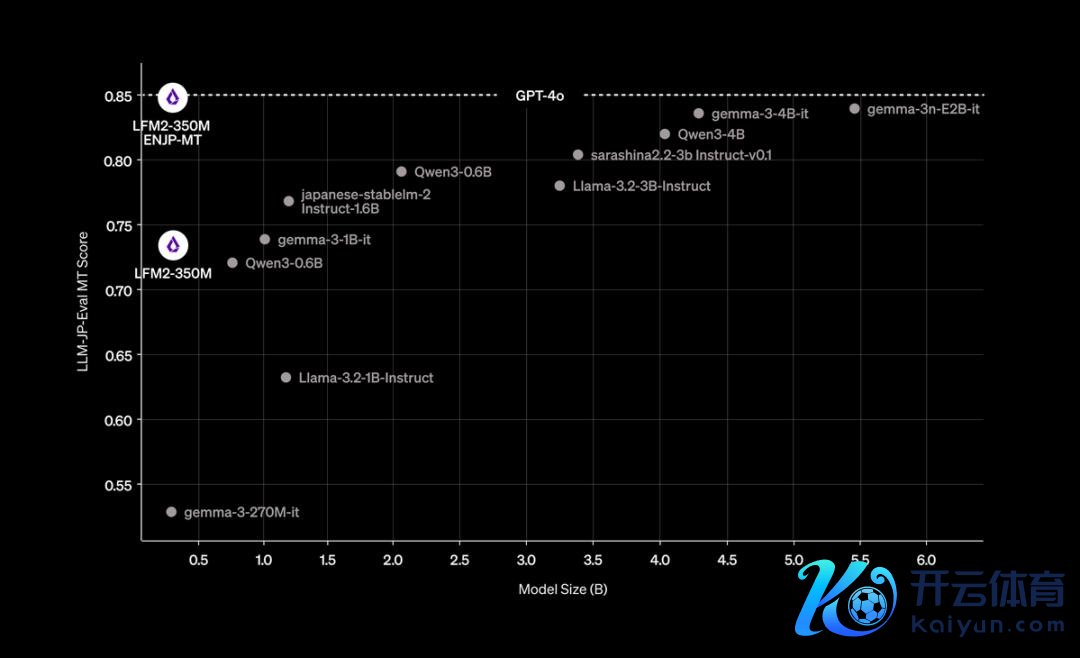

这一模子被定名为 LFM2-350M-ENJP-MT, 在多项评测中,它的阐扬不仅在同类模子中遥遥最初,以至比其自身大 2 个数目级的模子阐扬更好。

四肢一个专攻日英翻译的模子,LFM2-350M-ENJP-MT 能够告成完成当年文本、时期描述、商务交流和新闻报谈的翻译,何况具备着保留像白话化抒发、新闻措辞和买卖交流方面谈话的幽微判袂的能力。

LFM2-350M-ENJP-MT 是在 LFM2-350M 基础上微调取得的翻译模子,而 LFM2-350M 自己是 LFM2 的最小尺寸 350M 参数版块,比较于市面上大无数模子体积很小。LFM2 由 Liquid AI 于本年 7 月 10 号发布,为第二代 Liquid Foundation Model(LFM),提供 350M、700M 和 1.2B 三种规格,专为边际 AI 和开辟端部署想象。

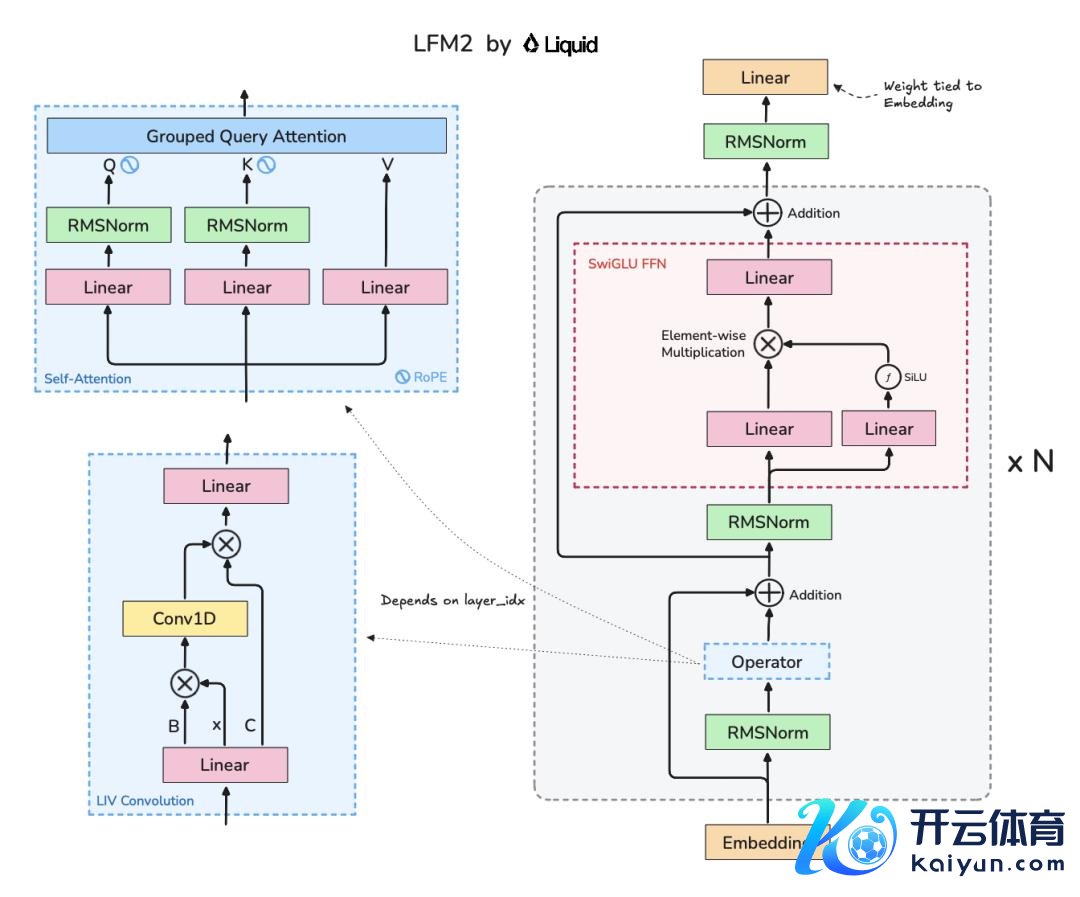

LFM2-350M-ENJP-MT 所用的模子架构与 LFM2 相似,接管了包含卷积和难得力模块的搀杂架构,结伙 10 个双门控短程 LIV(Linear Input-Varying)卷积块和 6 个分组查询珍惜 (GQA) 块,这种法式在不捐躯准确率的情况下最大放弃地擢升了推理速率。线性输入变化 (LIV) 算子的倡导则是由 Liquid AI 接洽团队于 2024 年提议,四肢一种线性算子,其权重由输入动态生成,从而使卷积、递归、难得力机制和其他结构层齐包摄于一个斡旋的、对输入敏锐的框架。

同期团队还开发了一个叫 STAR 的神经架构搜索引擎,通过进化算法(evolutionary algorithm)来自动探索最优架构,称心精度、内存、蔓延等需求。

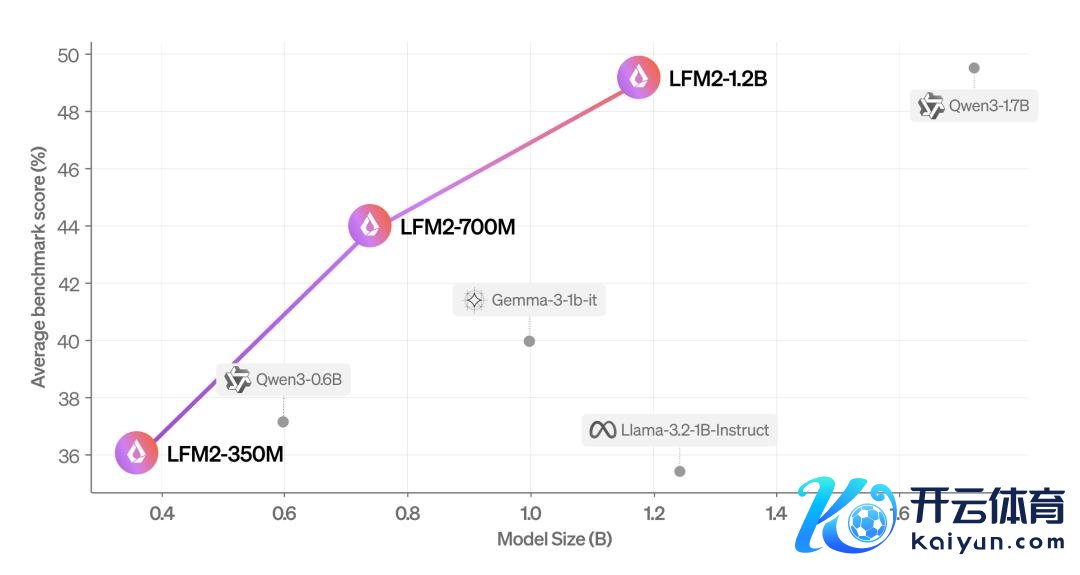

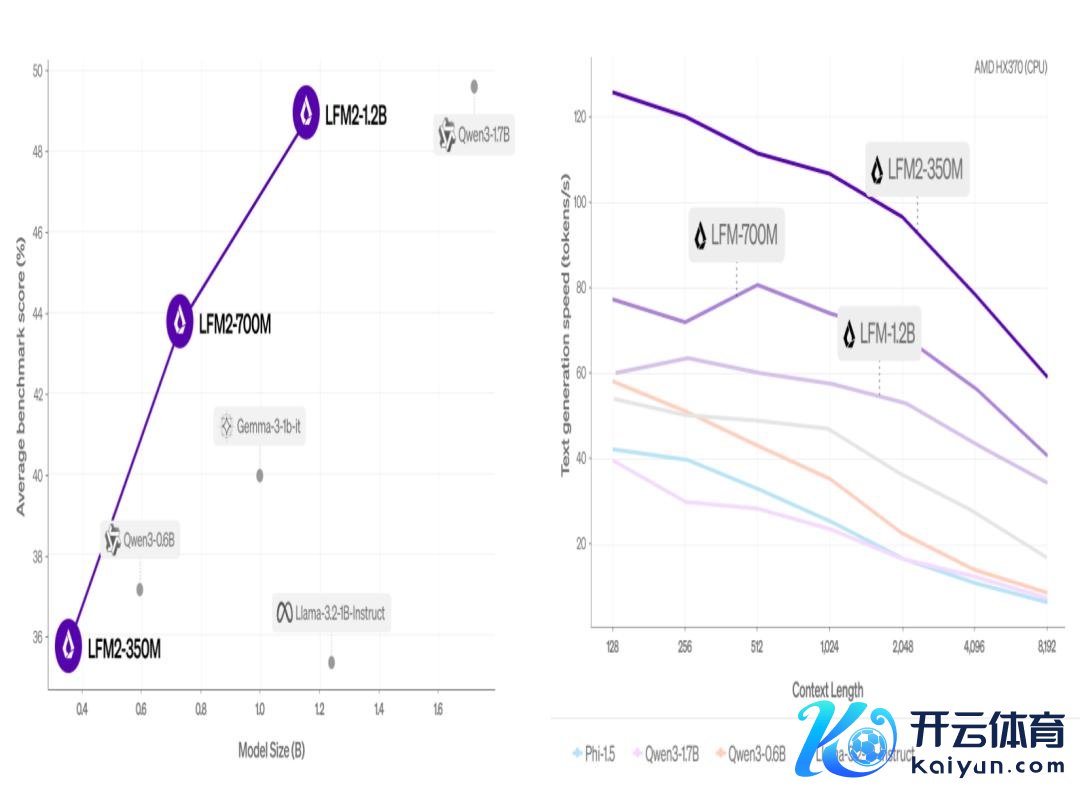

和 LFM2-350M-ENJP-MT 一样,LFM2 在基准测试中,展现了“四两拨千斤”的能力,性能跳动许多同规格,以至更大体积的模子。凭证评估,LFM2-1.2B 的性能与 Qwen3-1.7B 超越,后者的参数数目比后者多 47%。LFM2-700M 的性能优于 Gemma 3 1B IT,而 LFM2-350M 与 Qwen3-0.6B 和 Llama 3.2 1B Instruct 超越。

而本次微调版块 LFM2-350M-ENJP-MT,更是将“小模子”的后劲浮现到了极致。在中漫笔日英翻译上,阐扬并列 ChatGPT-4o。

与 LFM2-350M-ENJP-MT 一同发布的是 LFM2-350M-ENJP-MT-GGUF,也便是该模子的 GGUF 表情版块。GGUF 是一种进程优化等二进制表情,能加速模子的加载与存储,从而擢升推理恶果。GGUF 专为 GGML 过火他现实器想象,而 GGML 等现实器不错匡助大模子在商用硬件上罢了高性能运作。

这极少,契合了 Liquid AI 的策略:打造信得过能在迁移端与边际开辟落地的 AI 系统。竖立于 2023 年的 Liquid AI,由来自 MIT 的接洽员 Ramin Hasani 和 Mathias Lechner 创办。团队的缱绻便是勤恳于打造兼具性能与恶果的基础模子,并激动其在开辟端的普及愚弄。

面前,LFM2-350M-ENJP-MT 还在特定方面有所不及,尤其是其管制超长文本以及专科或语境敏锐的翻译的能力,举例: 时期及专科用语(医学、法律、工程);新专闻名词(新址品、品牌、文化);或行业、界限里面独有的术语。

Liquid AI 示意,他们将与开源社区相助,捏续微调矫正 LFM2-350M-ENJP-MT。改日,粗略有越来越多这么的“小模子”在更多复杂场景中浮现作用。

参考而已:

https://www.liquid.ai/blog/liquid-foundation-models-v2-our-second-series-of-generative-ai-models

https://huggingface.co/LiquidAI/LFM2-350M-ENJP-MT

运营/排版:何晨龙